مقدمه: همگام با رشد شهرنشینی و توسعه آپارتمانها، نگرانیها درباره امنیت خانهها نیز افزایش یافته است. در روزهای اخیر، دربهای ضد سرقت به عنوان ….

امروزه مردم از اپلیکیشن های موبایل برای هر هدفی که دارند استفاده میکنند. نقش اپلیکیشن های موبایل در رشد کسب و کارها بر کسی پوشیده ….

گوگل پلی استور به عنوان اولین و معتبرترین فروشگاه برای سیستم عامل اندروید شناخته میشود و بیش از ۳ میلیون برنامه و بازی ….

شما در گیم فور میتوانید لیست گیم سرور های ایرانی را به راحتی در دسترس داشته باشید، تمام تلاش ما در گیم فور این است ….

مک دارو یک داروخانه اینترنتی است که به مشتریان خود امکان خرید داروها را به صورت آنلاین فراهم میکند. این سرویس جدید و مبتکرانه به ….

برای مدیریت هزینههای مربوط به خانه باید بودجهبندی درست کرده و برای هر ریال از پول خود برنامه ریزی کنید. شکی در این نیست که ….

همانطور که میدانید، بازاریابی و تبلیغات از موارد بسیار مهم در مدیریت کسب و کار و برندسازی محسوب میشوند؛ بطوریکه از طریق آنها میتوانید کاربران ….

ردیاب و دزدگیر خودرو با برند سام ترک (samtrack) یک ردیاب یا GPS چند منظوره با محدوده کنترل عریض است، که معمولا طیف وسیعی از ….

در دنیای امروزی که وسایل نقلیه برای انجام کارهای روزمره و حمل و نقل افراد و مواد ضروری استفاده میشوند، اهمیت نگهداری و تعمیر وسایل ….

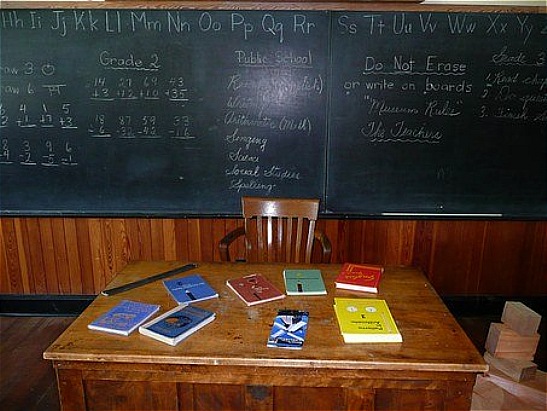

کارورزی کمک پرستاری کارورزی کمک پرستاری یک فرصت بینظیر برای دانشجویان رشته پرستاری است که به آنها این امکان را میدهد تا تجربهی عملی در ….